Los fraudes impulsados por inteligencia artificial están entrando en una fase sin precedentes. Según el Reporte de Identidad de Fraude 2025–2026 de Sumsub, basado en millones de verificaciones y más de cuatro millones de intentos de fraude analizados, el mundo vive un cambio acelerado en la manera en que operan los estafadores.

Aunque la tasa global de fraude bajó ligeramente de 2.6% a 2.2%, el nivel de sofisticación aumentó drásticamente: los ataques complejos registraron un incremento del 180% entre 2024 y 2025.

Sumsub denomina esta transformación como “The Sophistication Shift”, una evolución donde existen menos ataques, pero mucho más elaborados, automatizados y diseñados para causar daños amplificados. Este giro, advierte la compañía, exige que las organizaciones evolucionen a la misma velocidad.

Deepfakes en México: crecimiento explosivo del 484%

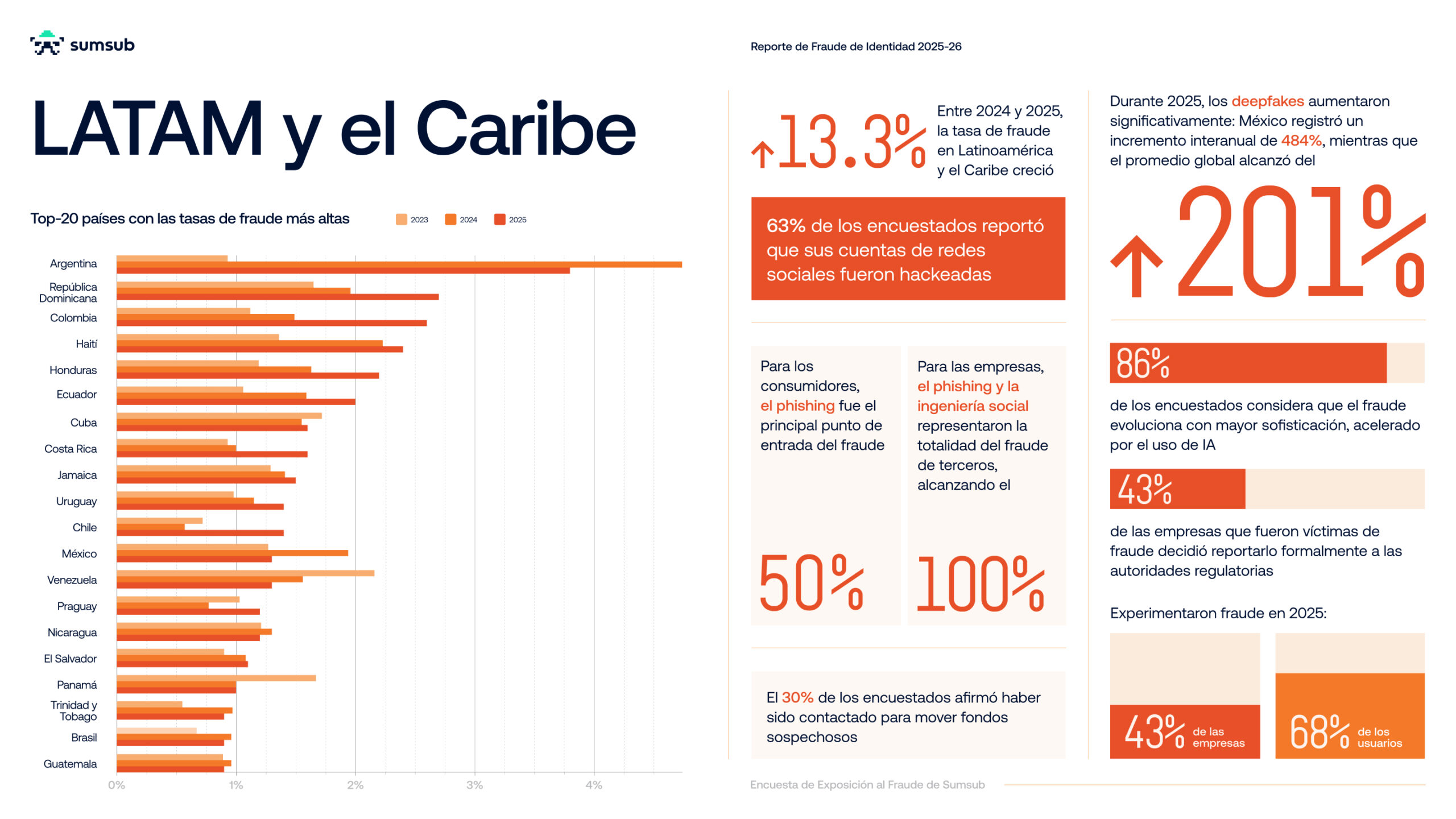

México redujo su tasa general de fraude a 1.3%, una caída del 32% interanual. Sin embargo, esta mejora convive con un fenómeno altamente preocupante: los deepfakes crecieron 484%, uno de los aumentos más altos a nivel global.

Este salto coloca al país entre los mercados más vulnerables ante fraudes generados con IA, especialmente en sectores donde la verificación de identidad es crítica.

En 2025, 40% de las empresas y 52% de los usuarios declaró haber sido víctima de algún tipo de fraude, según la Encuesta de Exposición al Fraude de Sumsub. A pesar de una tasa general más baja, las modalidades impulsadas por IA amplifican los riesgos y dificultan la detección por métodos tradicionales.

Fraudes asistidos por IA: más rápidos, más baratos y más difíciles de rastrear

En 2024, proliferaron los kits y plataformas de fraud-as-a-service, accesibles incluso para delincuentes sin habilidades técnicas. Para 2025, esta “democratización” dio paso a un fraude más profesionalizado y automatizado.

Entre los hallazgos más relevantes del reporte destacan:

• Los ataques multietapa pasaron de 10% a 28% en un año.

• La forja documental con IA subió de 0% a 2%, impulsada por herramientas como ChatGPT, Grok y Gemini.

• 75% de los especialistas cree que la IA será la fuerza principal detrás de los fraudes en los próximos años.

• Uno de cada 50 documentos falsificados ya es generado con IA.

Además, avances como Google Veo 3.1 y OpenAI Sora 2 están llevando el contenido hiperrealista a un nivel que complica incluso la detección de marcas de agua o señales de manipulación gráfica.

Principales modalidades: de identidades sintéticas a bots autónomos

El fraude de primera parte —cuando el individuo es el propio actor fraudulento— domina con prácticas como:

• Identidad sintética (21%)

• Abuso de contracargos (16%)

• Fraude en aplicaciones (14%)

• Deepfakes (11%)

• Mulas de dinero (11%)

En los fraudes de tercera parte, es decir, ataques externos, las categorías principales son:

• Robo de identidad (28%)

• Robo de cuentas (19%)

• Pruebas de tarjetas (17%)

• Ingeniería social (16%)

• Bots (12%)

Por regiones, Medio Oriente encabeza el incremento con +19.8%, seguido por APAC (+16.4%) y África (+9.3%), mientras que Europa y Norteamérica registraron descensos.

Agentes de IA: la nueva amenaza invisible

El reporte alerta sobre el surgimiento de agentes autónomos impulsados por IA, capaces de ejecutar campañas de fraude completas sin supervisión humana directa. Un solo agente puede fabricar documentos falsos, generar deepfakes y sostener conversaciones simuladas en segundos.

Los ataques también están evolucionando hacia la manipulación del contexto de verificación, alterando señales de telemetría, SDKs, APIs y pipelines de datos para simular comportamientos legítimos y evadir sistemas de seguridad.

“La IA transforma tanto el ataque como la defensa”, afirmó Pavel Goldman-Kalaydin, Head of AI/ML en Sumsub. El reto, añade, será incluso verificar la identidad de agentes de IA que operen en nombre de usuarios reales.

Cómo deben prepararse las empresas rumbo a 2026

Sumsub propone una estrategia integral para enfrentar este nuevo panorama:

• Equipos de cumplimiento evolucionados hacia unidades de inteligencia de riesgo.

• Verificación continua, basada en telemetría del dispositivo, comportamiento e inteligencia contextual.

• IA como columna vertebral de las operaciones de prevención.

• Verificación segura de agentes de IA, ante su creciente participación en transacciones digitales.

Con el crecimiento acelerado del fraude asistido por IA, las organizaciones mexicanas deben adoptar herramientas avanzadas que permitan detecciones en milisegundos, modelado de comportamiento y sistemas autoaprendientes para mantenerse a la par de los atacantes.